全球車用資安廠商 VicOne 內部資安研究實驗室 VicOne LAB R7 專注於探索智慧移動中的

AI 機器人的資訊安全挑戰,本月 8 日發表全球第一份《 AI 機器人資安風險與防護白皮書》。

VicOne LAB R7 負責人張裕敏( Ziv Chang )表示:「隨著 AI 驅動的機器人展現出的高度智慧與自主性,其所面臨的資安挑戰也日益複雜。對此,企業必須從源頭強化供應鏈安全,確保 AI 模型完整性,並透過行為監控與測試驗證來提升系統韌性。唯有如此,AI 機器人才能在持續帶來創新價值的同時,保障運行安全無虞。VicOne 期許透過發表全球首份《 AI 機器人資安風險與防護白皮書》白皮書,讓產業及決策者在享受AI創新帶來便利的同時,也能正視背後的資安挑戰,並在標準化與法規面積極作為,一同確保「風險可控」AI 機器人可以造福人權且安全無虞。」

中文版的《 AI 機器人資安風險與防護白皮書》共有 17 頁,每一頁內容精簡到位,且層次清晰陳述,以下我們將白皮書的內容做一個簡短的摘要介紹。

- 第一段: 盤點機器人的整體攻擊面,介紹可能遭受攻擊的層面與案例。

- 第二段: 分析主流的攻擊方法及已知威脅,包括針對AI模型的獨特攻擊和機器人特有的風險。

- 第三段: 討論供應鏈安全挑戰,以及機器人行為層面的安全測試驗證方法。

- 第四段: 報告將探索新興風險與未來趨勢,如多模態大型模型(VLM/VLA)帶來的新攻擊向量、 機器人自適應擴增能力(技能)下載機制的潛在隱憂,以及 AI 驅動的攻擊手法演進。

- 第五段: 《 AI 機器人資安風險與防護白皮書》提出實際且可落實的結論,例如強調安全設計需未雨綢繆,研發一開始就必需將資安視為核心需求,進一步呼籲確保 AI 機器人安全需要整個生態系統的協作,產官學研各界協同合作,共同建立機器人安全的標準與法規體系,同時也提供產業界廠商們可以合作的作為方式與內容,針對政府機關也提出建議考慮為機器人制定必要的監管措施,甚至也提到立法者可以針對 AI 機器人出臺指引,要求基本的安全配備(如緊急停止功能)和軟體更新義務,以杜絕最低標準以下的不安全產品流入市場。最後也期盼學術界和研究機構應獲得更多資源,以投入AI 機器人安全相關的前沿技術研發,尤其是高難度的 AI 對抗攻防領域,做為產業發展提供安全的基石。

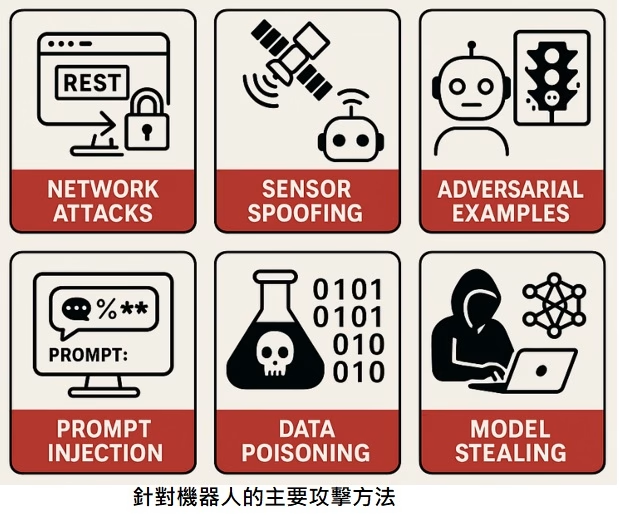

進一步,摘要《 AI 機器人資安風險與防護白皮書》其中一段分享給大家 ,目前針對 AI 系統和機器人的攻擊技術,涵蓋了從傳統的網路滲透到專門對抗 AI 模型的多種手法。以下整理幾種現有常見的針對機器人的攻擊方式:

- 通訊與網路攻擊:利用機器人暴露的網路介面或通訊協定弱點,進行未經授權的存取或控制。

- 感測器欺騙:對機器人的各種感測器提供惡意或誤導性輸入,令其對環境的感知出現偏差。

- 對抗性樣本攻擊:這是針對 AI 模型的一種巧妙攻擊,透過設計特殊的輸入使模型產生非預期的錯誤判斷。

- 提示詞注入與指令欺騙:隨著大型語言模型(LLM)被廣泛應用於機器人的決策系統,出現了一 種針對 LLM 的新攻擊手法,即提示詞(Prompt)注入。

- 資料投毒與模型毒化:攻擊者在 AI 模型的訓練或更新階段惡意摻入有偏或帶後門的資料,讓模型 在未來某些特定情境下表現異常,甚至按照攻擊者預期執行。

- 模型提取與逆向工程:攻擊者透過一系列方法窺探並獲取機器人內部 AI 模型的參數或機密知識。

《 AI 機器人資安風險與防護白皮書》將這六種的攻擊方式,不僅詳細解說,同時還有許多淺顯易懂的舉例說明,小編推薦大家閱讀完整內容。

完整的《AI機器人資安風險與防護白皮書》已可於VicOne網站免費下載中文版:https://cdn.vicone.com/files/VicOneLabR7/2025-AI-Robot-Cybersecurity-White-Paper-zh.pdf

關於VicOne

VicOne 自 2022 年成立以來,LAB R7 即同步投入 VLM、LLM 等可解釋人類想法的 AI 工具研究。VicOne 研究發現,雖然 AI 技術與車輛資安發展軌跡相似,但兩者的資安重疊性卻僅達 65% 至 70%,顯示 AI 機器人所面臨的資安風險更加難以防範。隨著 AI 驅動機器人具備高度智慧與自主性,並能在多元場域與人類互動,LAB R7 呼籲其安全性不再是附加選項,而應該是產品設計的核心要求。